Jusqu'à présent, lorsque vous aviez une nouvelle tâche à réaliser, vous aviez deux options. Le faire vous-même, ou demander à quelqu'un de le faire pour vous. Avec l’AI First, vous ajoutez une troisième option à envisager avant les deux autres : demander à l'IA de le faire pour vous.

Ce changement radical de mode de travail pourrait faire exploser notre consommation d'IA et son empreinte environnementale. Voici la logique :

- la priorité sera donnée aux agents IA pour la réalisation d’une grande partie du travail tertiaire, que ce soit de simples tâches ou des métiers complets,

- notre consommation d'IA se fera principalement via ces agents IA, eux-mêmes pouvant sous-traiter à d'autres agents IA, ce qui pourrait multiplier par plus de 1000 notre consommation de tokens (Les tokens sont les unités de sens pour les IA Génératives de texte).

- les entreprises vont devoir intégrer l'empreinte des services IA dans leur bilan carbone qui pourrait fortement augmenter

- en conséquence directe, l'empreinte de l'IA générative pourrait facilement ajouter de 550 à 1650 kgCO2 par collaborateur par an (je vous donne les détails des calculs plus loin dans l'article) !

Sommes-nous entrés dans l'ère du tokenageddon ?

Dans cet article, je partage mon point de vue, en m'appuyant sur des sources variées, sans pour autant appliquer de méthode scientifique. Il s'agit d'un raisonnement prospectif visant à souligner les défis à venir.

Alors que tout le monde veut bien concéder que l'utilisation de l'IA générative est en forte croissance, il me semble que la plupart des décideurs et des chefs d'entreprise n'ont pas compris dans quelle mesure, et à quelle vitesse.

En temps normal, j'utilise l'IA pour de la synthèse d'information et pour m'aider à la réflexion, mais pas pour de la rédaction de contenu. Concrètement je fais une douzaine de requêtes courtes par jour, ce qui correspond à échanger moins de 35 000 mots par jour, soit moins de 50 000 tokens (1 token = 0.75 mots en moyenne).

Bien sûr, si j'avais utilisé intensément GTP, Mistral ou Gemini pour rédiger cet article ou pour d'autres contenus, je pourrais multiplier ce chiffre par 10 ou 20. Auquel cas ma consommation pourrait atteindre le million de tokens par jour.

Cette tendance à l'augmentation de la consommation de tokens est globale : Entre fin 2023 et fin 2025, la taille moyenne d'un prompt (input) a quadruplé, passant de 1 500 à plus de 6 000 tokens [2]. La complétion (output) a elle aussi triplé [3].

Mais cela reste bien en dessous de ce que consomment les développeurs faisant du vibe coding. Leur consommation moyenne dépasse les 100 millions de token par jour ! Demandez leurs, ils vous le confirmeront. 100 millions de tokens, c'est environ 200 000 pages de texte. Si l'on compte que 100 pages font 1 cm d'épaisseur, cela représente une pile de 20 mètres de haut. Un immeuble de 7 étages... tous les jours. C'est un changement d'échelle de plusieurs ordres de grandeur.

Pour vérifier ce chiffre faramineux, vous pouvez aller consulter le site tokscale où l'on voit bien que les développeurs champions de l'IA consomment plusieurs centaines de millions par jour, et dépassent de temps à autre plusieurs milliards de tokens/jour consommés (plus haut que la tour Eiffel si l'on continue sur la métaphore de la pile de papier).

La différence entre eux et moi ? Je ne suis pas AI First, eux le sont. Basculer de l'un à l'autre peut multiplier par 1000 notre consommation de tokens.

Quels sont les métiers qui peuvent s' IA-former (se transformer par l'IA) ?

Sommes-nous bien sûrs que seuls quelques développeurs sont concernés par ces changements de pratiques ? Le vibe coding est en très forte expansion, et pourrait bien être sur la voie de la généralisation. D'autant qu'il touche par effet rebond un nouveau public de non-développeurs ou de développeurs occasionnels.

J'ai testé il y a quelques temps l'utilisation d'environnement de développement IA pour d'autres tâches que du développement logiciel. En effet, peut-on utiliser Claude Code ou Antigravity de Google pour organiser ses idées, ses vacances, ses notes, pour écrire un livre, pour créer un jeu de plateau, pour rédiger des partitions de musique, pour créer des powerpoints sur tous sujets, pour tous projets personnels ou professionnels ? Je vous confirme que cela fonctionne très bien grâce l'incroyable polyvalence des grands modèles de langage et à l'efficacité de l'approche agentique associé à un environnement de travail dédié.

J'en étais à me demander s'il serait pertinent d'inventer un environnement pour les consultants souhaitant faire du vibe consulting quand j'ai vu que tous les grands s'organisent pour faire basculer toutes les professions vers ce mode de fonctionnement. Deux exemples révèlent qu'il s'agit bien de la stratégie des géants de l'IA :

-

OpenAI (ChatGPT) sort Frontier, sa plateforme d'agents métiers autonomes qui peuvent être des spécialistes de la paie, des RH, du marketing, de la finance, du support client, des achats... bref de tout. Actuellement en phase de test, ces agents seront proposés à toutes les entreprises du monde.

-

Anthropic sort Claude Cowork pour outiller les "cols blancs" de façon similaire à ce qu'ils proposent aux développeurs, avec une forte intégration dans microsoft office 365, avec Teams, et avec le poste de travail. L'idée est de déployer des agents spécialisés pour tous les rôles de l'entreprise. Ces agents prêts à l'usage sont directement activables : commercial, gestionnaire générique, product manager, marketer, assistant conformité & réglementation, finance, designer, assistant RH...

-

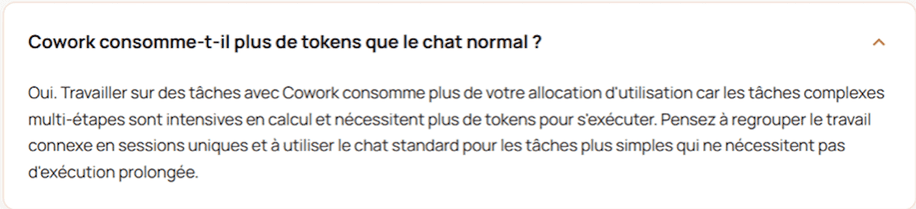

La FAQ de Claude est explicite sur la forte consommation de tokens par Cowork

En résumé, une transformation de l'ensemble de travailleurs utilisant un ordinateur est en cours et devrait nous faire TOUS passer d'une consommation ponctuelle de l'IA-en-mode-chat à une consommation quotidienne et intensive de l'IA-en-mode-agent. L'idée qu'à l'avenir nous serons tous des managers d'IA se concrétise en 2026.

Matt Shumer pense que cette transformation pourrait se faire à la vitesse COVID. Il ajoute que « L'expérience vécue par les professionnels de la tech au cours de l'année écoulée, celle de voir l'IA passer d'« outil utile » à un outil qui « fait mon travail mieux que moi », est celle que tout le monde est sur le point de vivre. Droit, finance, médecine, comptabilité, conseil, rédaction, design, analyse, service client. ». Pour Shumer, cet avenir n’est pas pour dans dix ans. Il est déjà là.

Plus proche de moi, frederick marchand(mon boss) témoignait récemment de la capacité de l'IA à réaliser de façon autonome en une nuit ce qui aurait nécessité 10 jours de travail à temps plein.

Les émissions de CO2 de l'IA First pourraient se compter en kg par jour

Concrètement, que signifie consommer 100 millions de tokens par jour, à l'année, pour tous les travailleurs du sectaire tertiaire ?

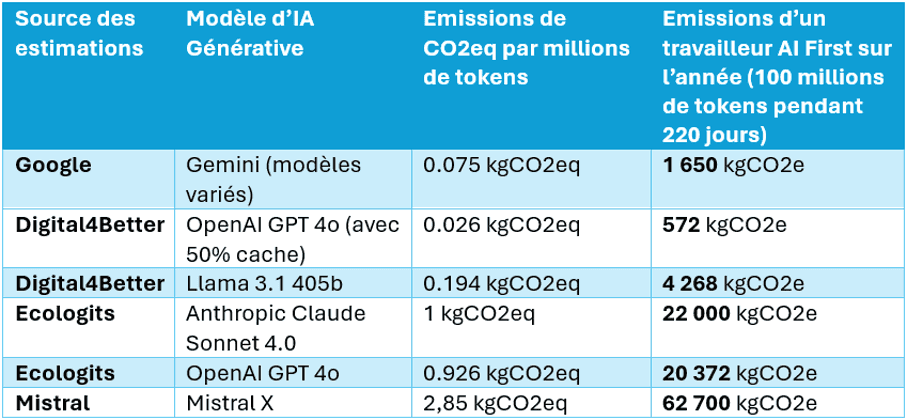

Cette réponse est particulièrement difficile à formuler avec précision tant les fournisseurs de modèles d'IA sont peu transparents sur les ressources consommées par leurs modèles. Idéalement, nous aimerions connaitre la quantité de CO2e émise par token. Pour se faire une idée je vous propose de comparer différentes méthodes d'estimation, et de présenter l’impact annuel pour quelqu’un consommant 100 millions de tokens par jour dans la colonne de droite :

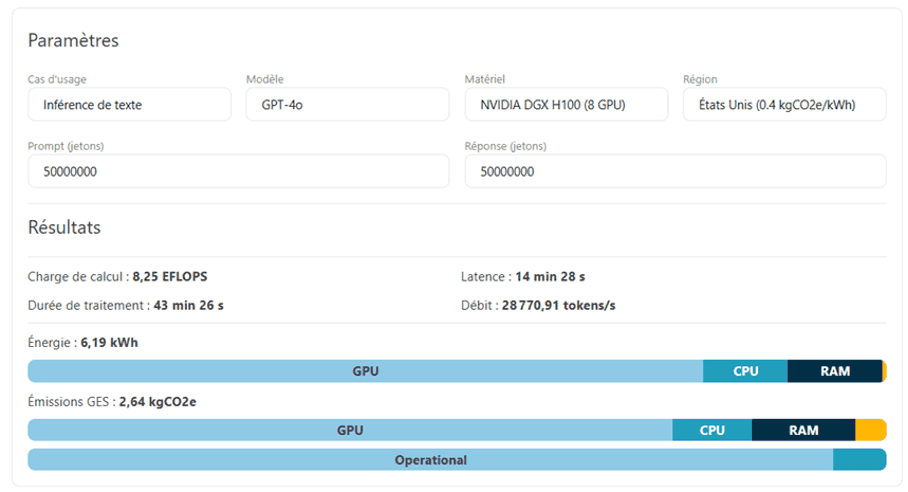

Ces résultats sont tellement assourdissants que je propose d'écarter les plus alarmants fondés sur les méthodes de Mistral ou d'Ecologits car ils ne semblent pas intégrer les optimisations en production dont sont capables les grands fournisseurs de LLM comme Google. Je vais m'appuyer en particulier sur notre méthodes Digital4Better (publiée en OpenSource) qui permet de prendre en compte la capacité de mise en cache du prompt, et en positionnant les tokens à 50% en entrée et 50% en sortie. Un simulateur est mis à disposition si vous voulez tester vous-même vous hypothèses.

Estimation par le simulateur de Digital4Better des émissions de 100 million de tokens de GPT 4o avec une répartition à 50% entre les tokens d'entrée et ceux de sortie.

Si l'on résume, l'empreinte environnementale annuelle de l'IA First pour un travailleur consommant 100 millions de tokens par jour pendant 220 jours se situerait entre 572 kgCO2eq et quelques tonnes. Il me parait clair que le traitement de tels volumes de tokens ne peut se faire sur des LLM peu optimisés, c'est pourquoi je me concentre sur un modèle Mixture-of-Expert (MoE) comme GPT 4o qui limite le nombre de paramètres actifs à 88 milliards de paramètres (tout de même). Néanmoins, même en prenant les hypothèses les plus basses, le fait d'ajouter entre 572 et 1650 kgCO2eq est absolument problématique. Une étude de WenR estime que l'empreinte moyenne annuelle du numérique pour un professionnel européen est de 265 kgCO2eq. L'AI First multiplie par entre 3 et plus de 6 l'empreinte environnementale du numérique du travailleur !

Des émissions de CO2 qui vont être difficiles à cacher

A l'année (220 jours ouvrés), cela représente 141 kgCO2eq ! C'est toutefois nettement moins que ce que prédisent de nombreux modèles d'évaluation, qui à mon sens ne prennent pas en compte plusieurs paramètres essentiels :

les spécificités des modèles réellement utilisés actuellement

les optimisations faites dans les environnements de production qui bénéficient d'effets d'échelle

la différence d'impact entre les tokens d'entrée et de sortie

les différents types de cache (cache d'inférence et cache de préfixe)

Mais si l'on résume, l'empreinte environnementale annuelle de l'IA First pour un travailleur consommant 100 millions de tokens par jour pendant 220 jours se situerait entre 141 kgCO2eq et quelques tonnes. En prenant l'hypothèse la plus basse, celle qui me semble la plus réaliste, de 141 kgCO2eq, cela reste absolument problématique. Ces 141 kgCO2eq correspondent environ à l'empreinte que nous constatons en France pour des travailleurs du numérique. L'AI First multiplie par 2 l'empreinte environnementale du numérique du travailleur !

Des émissions de CO2 qui vont être difficiles à cacher

Tout d'abord je suis étonné que les impacts de cette mutation du travail ne soient pas plus documentés. Cacher des centaines de kgCO2e par collaborateur par an ne devrait pas être si facile, à moins tout simplement de ne pas les déclarer ! Mais l'époque n'est-elle pas à « fonçons, quel qu'en soit le prix, on réfléchira plus tard » ?

Toutefois plusieurs limites peuvent venir ralentir cette transformation :

Le coût de l'IA-First. Si les licences de Claude Cowork commencent à 20€, il faut une licence à 100€ pour l'utiliser réellement. Et bien souvent les développeurs utilisant cette licence se plaignent d'atteindre trop vite les limites. Et le forfait ChatGPT Pro est à 230€/mois. Les entreprises ne vont plus pouvoir s’appuyer sur du Shadow AI^

De plus, il est probable que les prix des licences augmentent avec l'usage pour amortir les coûts considérables d'investissement.

Le temps de déploiement des nouveaux centres de données nécessaires pour l'AI-First. Par exemple, pour les investissements connus, les constructions d'hyperscaler pour la France vont s'étaler jusqu'en 2035. Des limites foncières, politiques, économiques et d'accès à l'énergie existante.

Le temps de transformation des pratiques professionnelles. Cette transition me semble au moins aussi complexe que de passer du rôle d'opérateur à celui de manager. Ce n'est plus le même métier.

Je rejoins dans cette conclusion celle du dernier rapport du Shift Project qui, à propos des projets de construction de datacenters en France, prévient que « Les raccordements validés aujourd’hui atteindront leur pleine capacité autour de 2035 et risquent d’induire des tensions sur le système électrique et des conflits d'usages. (…) Conserver la dynamique actuelle rendrait caduque l’atteinte des objectifs de décarbonation du secteur pour 2030, en inventaire national et en empreinte. »

Pour ma part, si j'en avais la possibilité, j'ajouterai une proposition de loi qui imposerait à tous les fournisseurs de LLM en SAAS de fournir systématiquement et quelque soit le mode d'utilisation (en chat, en api, en mode vibe...) le nombre de tokens consommés (entrée, sortie, cache). C'est ça la transparence !

Pour conclure, dans notre époque troublée, faut-il mettre toute notre énergie dans l’AI first quand le changement climatique nous attaque, que l'impact social est imprévisible et que nous ne sommes pas souverains sur cette technologie ?

Cet article n'a aucunement été rédigé par IA, mais l'IA a été utilisée pour la réflexion et la recherche d'information

[1] OpenRouter API Insights - Evolution des tailles de prompts (2023-2025) : [openrouter.ai](https://openrouter.ai/)

[2] Data Engineer Things - Guide sur les tokens et coûts : [dataengineerthings.org](https://dataengineerthings.org/)